AI schodzi z pokazów. Wchodzi do wojska i firm.

AI kończy etap widowiska dla inwestorów i geeków. W piątek widać to było naraz w trzech światach: Pentagon podpisał umowy z siedmioma firmami, OpenAI weszło z modelami i agentami do firmowej chmury Amazona, a Mistral przeniósł agentów kodujących z laptopa do zdalnej pracy. To nie są już zabawki do pokazu. To infrastruktura, która ma podejmować decyzje, pisać kod i pracować w organizacjach z procedurami, budżetem i odpowiedzialnością.

AI idzie na służbę państwową

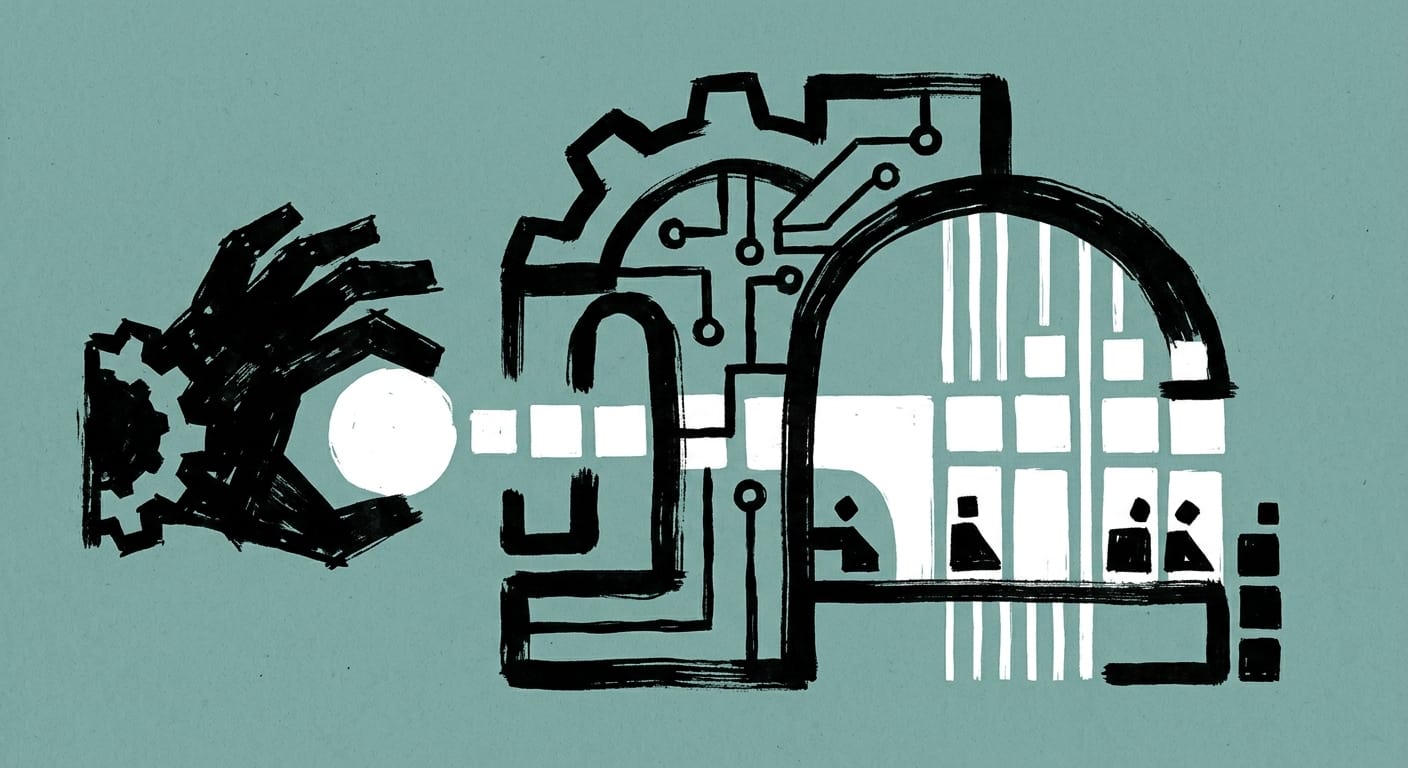

Pentagon podpisał umowy z siedmioma firmami AI, w tym OpenAI, Google, Microsoftem, Nvidią i Amazonem. W praktyce oznacza to, że sztuczna inteligencja przestaje być dodatkiem do biurowych narzędzi, a staje się elementem państwowej machiny, używanym przy analizie danych i wspieraniu decyzji w środowisku wojskowym. Gdy taka technologia trafia do armii na zasadzie "każde zgodne z prawem użycie", kończy się komfortowa opowieść o neutralnym narzędziu. Zaczyna się spór o granice odpowiedzialności.

Departament Obrony USA ogłosił porozumienia z siedmioma firmami AI dla środowisk niejawnych i operacyjnych. Kluczowy detal to zgoda na "any lawful use", czyli bardzo szeroki zakres wdrożeń w analizie, syntezie danych i wspomaganiu decyzji. Anthropic pozostał poza układem po sporze o zabezpieczenia i użycie modeli w nadzorze oraz systemach autonomicznych. Rynek dostał jasny sygnał: zamówienia publiczne wchodzą w fazę, w której ważniejsze od demonstracji są zgodność, gotowość wdrożeniowa i gotowość do przyjęcia ryzyka politycznego.

OpenAI chce być warstwą roboczą korporacji

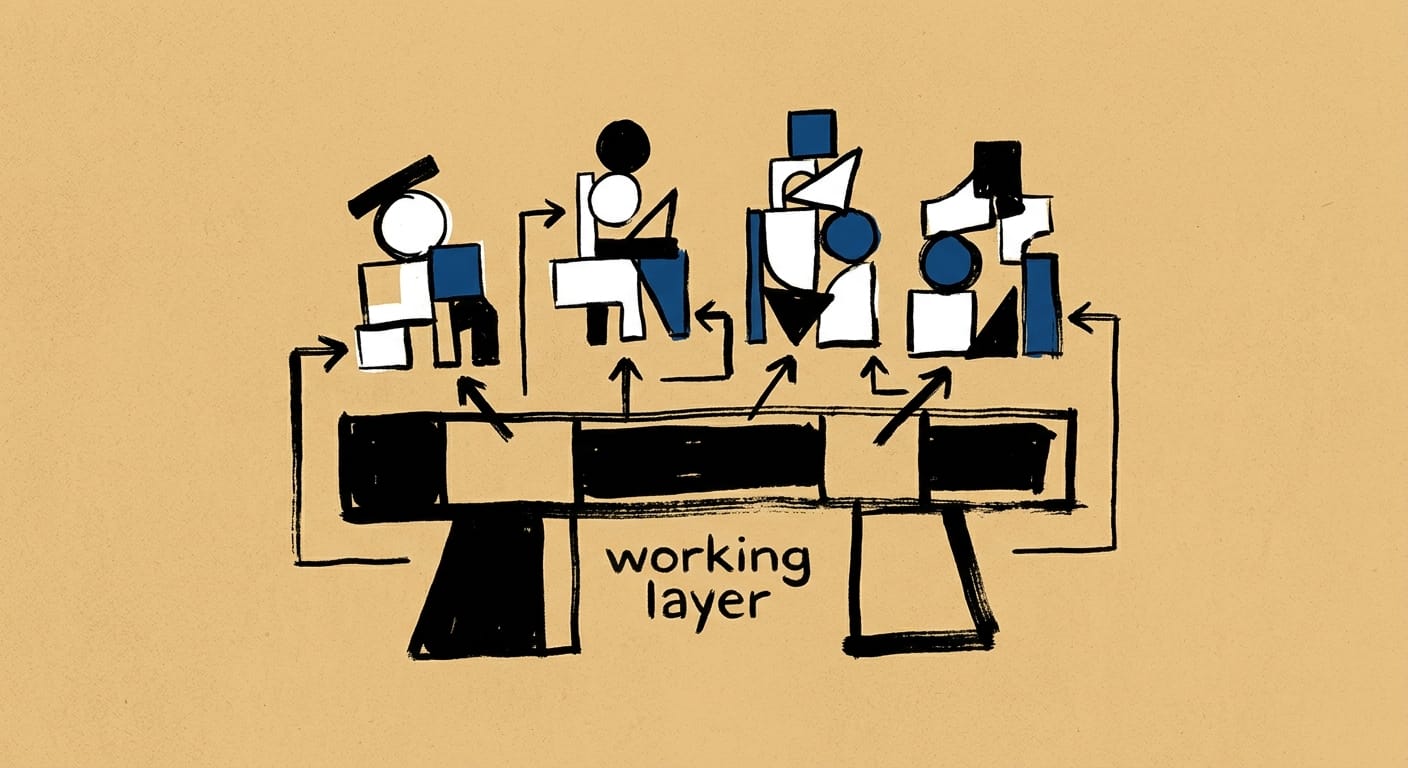

OpenAI nie sprzedaje już tylko samego modelu. Wchodzi do chmury Amazona z gotowym pakietem dla firm: modelami, Codexem do pracy programistycznej i agentami wykonującymi zadania krok po kroku. Dla menedżera to ważna zmiana, bo oznacza krótszą drogę od eksperymentu do wdrożenia. Zamiast kupować osobno silnik, nadzór i integracje, firma dostaje to w miejscu, gdzie już ma budżet, zabezpieczenia i umowy.

OpenAI uruchamia na AWS trzy warstwy naraz: modele z GPT-5.5 na Amazon Bedrock, Codexa działającego w infrastrukturze AWS i Bedrock Managed Agents z technologią OpenAI. To ruch typowo platformowy. Nie chodzi już o samą jakość modelu, tylko o wejście w istniejące procesy zakupowe, bezpieczeństwo, zgodność i rozliczenia dużych organizacji. Jeśli ten układ chwyci, przewaga przesunie się z interfejsu czatu na pełny stos wdrożeniowy dla agentów.

AI przestaje obiecywać, że kiedyś pomoże w pracy. Ono właśnie zabiega o etat, budżet i przepustkę do strefy zamkniętej.

Mistral przenosi agentów do chmury, Europa nie chce zostać z tyłu

Mistral zrobił ruch, który wygląda technicznie, ale ma czysto biznesowy sens. Zamiast trzymać agenta kodującego na laptopie, pozwala wysłać go do zdalnej pracy w chmurze, uruchamiać kilka zadań równolegle i wrócić dopiero po wynik. To różnica podobna do przejścia z freelancera siedzącego obok ciebie na zespół, który pracuje także wtedy, gdy ty śpisz. Dla europejskiej firmy to sygnał, że własny gracz nadal umie nadawać tempo, a nie tylko gonić Amerykę.

Mistral uruchomił zdalnych agentów w Vibe oraz Mistral Medium 3.5 jako domyślny model dla Vibe i Le Chat. Nowy model ma 128 mld parametrów, okno kontekstu 256 tys. tokenów i wynik 77,6 proc. w teście wydajności SWE-Bench Verified. Najważniejsza nie jest jednak sama punktacja, tylko architektura produktu: sesje agentowe działają asynchronicznie w izolowanych środowiskach, można je przenosić z lokalnego CLI do chmury i spinać z GitHubem, Jirą czy Sentry. To przybliża agentów do realnego przepływu pracy zespołów programistycznych.

Miliardy zaczynają się bronić

Jeszcze kilka miesięcy temu łatwo było mówić, że wielkie firmy przepalają fortunę na AI. Teraz coraz wyraźniej widać, że przynajmniej część tych pieniędzy zaczyna pracować. Google przekonuje inwestorów wynikami chmury, a branża oswaja się z myślą, że całoroczne wydatki największych firm technologicznych na infrastrukturę AI mogą sięgnąć 700 mld dolarów. To skala budowy nowej energetyki albo kolei, tylko że tym razem tory są z krzemu.

Po wynikach Alphabetu rynek zaczął wyraźniej odróżniać firmy, które tylko zwiększają nakłady inwestycyjne, od tych, które już pokazują monetyzację w chmurze i usługach dla przedsiębiorstw. Reuters opisywał, że narzędzia AI stały się głównym motorem wzrostu Google Cloud, przy jednoczesnym wzroście presji na dalsze inwestycje całej wielkiej technologii. Szacunki rzędu 700 mld dolarów rocznie na infrastrukturę AI przestają wyglądać jak bańka narracyjna, a coraz bardziej jak próg wejścia do rynku, na którym wygrywa ten, kto ma kapitał, klientów i własną infrastrukturę obliczeniową.

Hollywood stawia granicę

Akademia Oscarowa powiedziała wprost: nagradzani mają być ludzie, nie syntetyczne postacie i nie scenariusze napisane przez model. To ważne nie tylko dla kina. Każda branża kreatywna będzie musiała odpowiedzieć na to samo pytanie: czy AI jest narzędziem wspierającym autora, czy podstawia autora na jego miejsce. Oscary właśnie uznały, że tej granicy nie wolno rozmyć.

Nowe zasady 99. Oscarów wymagają, by role aktorskie były wykonane przez ludzi za ich zgodą, a scenariusze były autorstwa człowieka. Akademia zastrzegła też prawo do żądania dodatkowych informacji o użyciu generatywnej AI i ludzkim wkładzie twórczym. To istotny precedens regulacyjny, bo nie dotyczy zakazu narzędzi jako takich, tylko ustalenia progu autorstwa i kwalifikowalności do najważniejszego wyróżnienia w branży.

Komentarz dnia

Najciekawsze w AI nie dzieje się dziś w laboratorium. Dzieje się przy podpisywaniu umów, pisaniu regulaminów i podłączaniu modeli do systemów, których nikt nie może wyłączyć jednym kliknięciem.

Dlatego sobotni przegląd nie układa się w historię o jednym nowym modelu. Układa się w historię o dojrzewaniu rynku. Gdy technologia wchodzi do wojska, do firmowych zakupów i do zasad Oscarów, kończy się okres ulgowy. Od tej chwili liczy się nie tylko to, co model potrafi, ale też kto bierze za niego odpowiedzialność.

Co mówią twórcy

Nick Saraev: How to Use Claude Code for FREE (2026)

- Najmocniejszy wniosek: koszt agentów da się ciąć przez podmianę zaplecza modelowego, bez rezygnacji z wygodnego interfejsu.

- Model premium ma sens jako nadzorca i recenzent, a tańsze modele mogą robić ciężką, powtarzalną robotę.

- Przy długich sesjach tanie modele szybciej gubią jakość, więc opłaca się częściej resetować kontekst niż pompować jeden wątek bez końca.

Nate B. Jones: Anthropic Might Buy Atlassian For $40B. Here's Why It Makes Sense.

- W świecie agentów wygrywa nie najładniejszy czat, tylko system z trwałym stanem pracy, odpowiedzialnością i historią decyzji.

- Jira, Linear i podobne narzędzia mogą stać się dla agentów tym, czym ERP był dla klasycznego biznesu: miejscem prawdy o procesie.

- To cenna kontra dla mody na "samodzielnych agentów" bez zaplecza operacyjnego.

Aniket Panjwani: OpenAI Codex Full Course 4 Hours: Build & Ship

- Przewaga narzędzi agentowych coraz częściej nie wynika z modelu, tylko z tego, jak dobrze ogarniają równoległość, wtyczki i zarządzanie kontekstem.

- Codex jawi się tu bardziej jako środowisko operacyjne niż zwykły asystent do kodu.

- Największy zysk daje delegacja: wiele zadań, wiele agentów, mniej ręcznego pilnowania każdego kroku.

Riley Brown: Codex Replaced Claude for Me… Here’s Why

- Rynek zmierza do jednej "superapki" do pracy wiedzy i kodu, a przewagę budują dziś interfejs, narzędzia i integracje.

- To ciekawie współgra z ruchem OpenAI do AWS i z premierą Mistrala: wszyscy budują nie model, tylko stanowisko pracy.

- Brown trafnie zauważa, że bitwa przesuwa się z jakości odpowiedzi na jakość całego przepływu pracy.

Na koniec

Jeszcze niedawno rozmowa o AI kręciła się wokół tego, czy model odpowiada mądrzej niż konkurent. Dziś ważniejsze jest co innego: kto podpisze umowę, kto weźmie odpowiedzialność i kto zbuduje system, któremu firma albo państwo naprawdę powierzy pracę. To moment, w którym rynek robi się mniej efektowny, ale dużo poważniejszy.

Rynek przechodzi z fazy demonstracji do fazy wdrożeń instytucjonalnych. Pentagon testuje granice użycia, OpenAI buduje kanał enterprise przez AWS, Mistral optymalizuje agentowy przepływ pracy, a Hollywood koduje zasady autorstwa. Najważniejszy trend dnia nie dotyczy nowego modelu, tylko tego, że AI staje się elementem infrastruktury, polityki i compliance. Od teraz przewaga będzie należeć do tych, którzy dowiozą nie tylko inteligencję modelu, ale pełny system odpowiedzialnego użycia.